Что должны учитывать компании и их руководители при внедрении технологии искусственного интеллекта |

Искусственный интеллект (ИИ) при его правильном использовании создает новые возможности, но также несет в себе и опасные риски при неправильном внедрении. В этой статье мы рассматриваем две стороны медали и выделяем те аспекты ИИ, на которые советы директоров и руководители компаний должны обратить пристальное внимание.

Как применять руководство от COSO в отношении ИИ-проектов

В июле Комитет спонсорских организаций Комиссии Тредвея (The Committee of Sponsoring Organizations of the Treadway Commission — COSO) представил новое руководство по управлению рисками в случае использования облачных технологий. А что насчет технологий искусственного интеллекта, становящихся все более популярными у передовых технологических компаний, которые стремятся использовать доступные им данные максимально эффективным способом? Впрочем, как всегда бывает, где возможности — там и риски, причем риски, которые в данном случае не изолированы в рамках отдельного IT-департамента, но затрагивают обширную совокупность различных организационных функций.

Как пишет Journal of Accountancy, в результате этого организациям необходимо перестраивать системы управления рисками и внутреннего контроля, чтобы держать ассоциированные с AI риски в рамках своих “аппетитов”. Эффективное управление рисками предприятия в таких условиях стало темой нового исследования, которое представил все тот же Комитет спонсорских организаций Комиссии Тредвея.

В руководстве с мотивирующим заголовком “Осознайте весь потенциал искусственного интеллекта” описано, как любая организация может применять Основы управления рисками от COSO во внедрении и управлении ИИ-проектами. Авторами его стали представители Deloitte & Touche LLP, поэтому ничего удивительного, что далее идут объяснения, касающиеся использования собственной системы управления рисками этой организации применительно к ИИ.

В полной мере осознавая все связанные с искусственным интеллектом риски, современные организации способны обеспечивать более высокую прибыль на инвестиции и более эффективно соответствовать ожиданиям своих ключевых стейкхолдеров.

ИИ может улучшить сложные процессы принятия решений, поэтому он является стимулом для преобразований в каждой отрасли. Технология эффективно выполняет сложные рутинные задачи и предоставляет руководству данные, которые раньше нельзя было собрать.

ИИ и управлении рисками предприятия

Машинное обучение — форма ИИ, в которой компьютерные алгоритмы со временем совершенствуются благодаря опыту использования данных, — играет все более заметную роль в управлении рисками предприятия. ИИ можно использовать для создания сложных инструментов анализа поведения и деятельности в режиме реального времени. Технология может приспосабливаться к изменениям в среде, поэтому она расширяет мониторинговый потенциал организации в таких сферах, как соблюдение регуляторных норм и корпоративное управление. Она может быть не только системой раннего предупреждения, но и системой раннего обучения, предотвращает воплощение угроз.

Снижение рисков

Хотя ИИ все еще развивается, его уже можно использовать для уменьшения рисков в некоторых ключевых сферах. Например, машинное обучение может прогнозировать вероятность неуплаты займа или платежа физическим лицом или организацией. Это можно использовать для построения моделей прогнозирования дохода с переменными.

В течение многих лет с помощью машинного обучения успешно выявляли мошенничество с кредитными карточками. Банки используют системы, которые ознакомлены с данным платежного баланса за прошлые годы, чтобы мониторить платежи на предмет потенциальной мошеннической деятельности и блокировать подозрительные транзакции. Финансовые учреждения также используют автоматизированные системы для своих специалистов, связывая информацию о торговле с другой информацией о поведении, такой как трафик электронной почты, записи в календаре, время прибытия и выхода из офиса и даже телефонные звонки.

Аналитические платформы на основе ИИ могут управлять рисками, связанными с поставщиками. Они обобщают разнообразную информацию о поставщиках, начиная с их географической и геополитической среды, заканчивая финансовыми рискам, оценки уровня устойчивости и социальной ответственности предприятий.

И наконец, системы ИИ можно научить выявлять, отслеживать и отражать кибератаки. Они идентифицируют программное обеспечение по определенным критериями — например, высокая процессорная мощность или передача больших массивов данных — и затем прекращают эту атаку.

Риски, связанные с внедрением ИИ

Несмотря на все преимущества искусственный интеллект также является источником новых рисков, которыми надо управлять. Поэтому важно определить риски, которые относятся к каждой отдельной программе ИИ и каждому бизнес-подразделению, использующему данную технологию.

Некоторые из рисков, связанных с ИИ

Предвзятость алгоритмов: алгоритмы на основе машинного обучения определяют закономерности данных и кодируют их в прогнозах, правилах и решениях. Если эти закономерности отражают некоторые существующие предубеждения, алгоритмы, вероятно, усилят это предубеждение, что может привести к усилению дискриминации.

Преувеличение возможностей: поскольку системы ИИ не понимают задач, которые они выполняют, и полагаются на свои учебные данные, они далеко не безошибочны. Достоверность их результатов может быть под угрозой, если входные данные будут предвзятыми, неполными или низкого качества.

Программные ошибки: ошибка в алгоритмах приводит к ошибочным результатам, что может иметь серьезные негативные последствия.

Риск кибератак: хакеры, которые хотят похитить личные данные или конфиденциальную информацию о компании, все чаще атакуют системы ИИ.

Правовые риски и обязательства: в настоящее время существует мало законов, регулирующих сферу ИИ, но это может измениться. Системы, анализирующие большие объемы данных о потребителях, могут не соответствовать действующим и будущим регламентам о конфиденциальности данных, особенно Общему регламенту о защите данных ЕС (GDPR).

Репутационные риски: Системы ИИ обрабатывают большие объемы конфиденциальных данных и принимают критические решения о лицах в целом ряде областей, включая кредитование, образование, занятость и здравоохранение. Таким образом, любая система, которая подверглась атаке или используется для неэтичных целей, создает существенные репутационные риски для организации.

Понимает совет директоров потенциальное воздействие ИИ на бизнес-модель, культуру и стратегию организации?

Что следует знать совету директоров — рекомендации экспертов EY Global

Советы директоров должны понимать, как ИИ применяется внутри организации и за ее пределами. Они должны обеспечить организацию соответствующими структурами для решения вопросов, связанных с этикой, и понять, как она преодолевает алгоритмические предубеждения.

Они также должны знать о новых структурах, политиках и законодательстве, чтобы обеспечить правильный баланс между прозрачностью алгоритмов и подотчетностью. В конце концов советы директоров должны быть уверенными в надежности своей «черного ящика» — термин, используемый для описания системы машинного обучения. Этого можно достичь с помощью тщательного осмотра. Он определяет, являются ли результаты такими, как ожидалось, и существуют ли соответствующие средства контроля для мониторинга этих систем в процессе их развития.

Основные вопросы для рассмотрения

Понимает совет директоров потенциальное воздействие ИИ на бизнес-модель, культуру и стратегию организации?

Как совет директоров побуждают руководство компании стратегически реагировать как на возможности, предоставляемые ИИ, так и на риски, связанные с ним?

Как организация использует технологию ИИ и новые наборы данных для руководства и управления рисками? Как меняются панели управления совета директоров и комитета по аудиту?

Существует ли в организации стратегия поиска и приема на работу талантливых людей с необходимыми навыками для управления и набора персонала на проекты, связанные с ИИ?

Просил ли совет директоров руководство оценить, как применение ИИ влияет на целостность его финансовой функции или его финансовой отчетности?

Преодоление рисков искусственного интеллекта

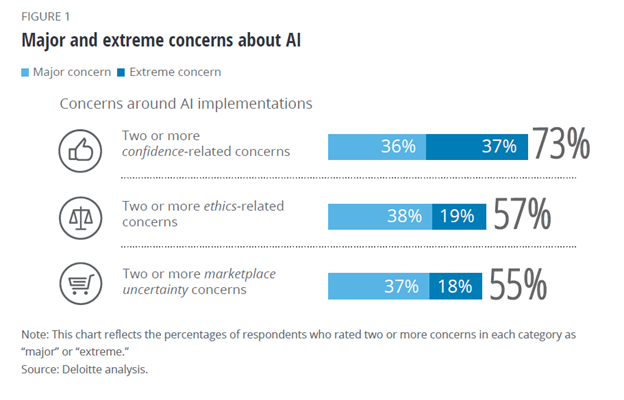

Эксперты Deloitte провели опрос 2737 руководителей ИТ- и бизнес-подразделений из девяти стран в период с октября по декабрь 2019 года. Все участвующие компании внедрили технологии искусственного интеллекта и поделились своим опытом, преимуществами и недостатками использования ИИ в работе.

Признание важности использования технологий искусственного интеллекта со стороны компаний за год выросло на 10%. При этом существует ряд вопросов, вызывающих обеспокоенность темпами внедрения ИИ. 56% опрошенных организаций заявляют, что они планируют замедлить или уже замедляют внедрение искусственного интеллекта из-за возникающих рисков.

В последнее время большое внимание уделяется рискам и негативным последствиям использования искусственного интеллекта.

Активные дискуссии ведутся по вопросам развития или упразднения рабочих мест, предвзятости и объективности ИИ при принятии решений.

Ключевыми факторами, вызывающими обеспокоенность темпами внедрения искусственного интеллекта, являются доверительность в процессе принятия решений ИИ, вопросы этики и использования данных, а также неопределенность на рынке. Доверительность в данном вопросе означает признание компанией надежности использования инструмента искусственного интеллекта, безопасность системы, а также способность понять, обосновать или объяснить процесс принятия решений ИИ. Этическая составляющая рассматривает, является ли использование искусственного интеллекта полезным для общества, а также вопросы конфиденциальности данных, справедливости, предвзятости и потенциальной потери рабочих мест. Неопределенность на рынке — это независящие от компаний факторы, такие как изменение нормативно-правовой базы, мнение общественности и сотрудников. Эти факторы не связаны с качеством ИИ, но они влияют на возможности его использования. На изображении ниже отражена степень важности данных факторов (по мнению участников опроса).

85% опрошенных заявляют о важности рисков, связанных с доверительностью искусственному интеллекту. Данные опасения наиболее тесно связаны с качеством продуктов и услуг, которые предоставляет компания, и таким образом оказывают влияние на репутацию компании.

Степень обеспокоенности компаний вопросами качества использования ИИ зависит от развитости самой компании. Крупные, развитые, успешные компании менее обеспокоены рисками от использования искусственного интеллекта, так как обладают большими ресурсами для повышения его качества.

57% процентов респондентов отметили важность этической составляющей использования ИИ. Особенностью этической проблемы использования искусственного интеллекта является то, что данные, используемые для принятия решений, могут быть неполными и предвзятыми.

55% респондентов указали на важность факторов неопределенности на рынке и вытекающие отсюда вопросы целесообразности инвестиций. Данная категория включает в себя широкий круг вопросов: от общественного мнения до неоднозначной нормативной базы. Обеспокоенность вызывают новые правила и нормы, касающиеся защиты данных, распознавания лиц и прозрачности решений. Компании, применяющие искусственный интеллект, обеспокоены реакцией общественности на ошибки ИИ, а также отношением сотрудников к использованию ИИ.

<...>

Войдите в систему или зарегистрируйтесь